OpenClaw与ChatGLM配置详解:高效部署AI对话模型指南

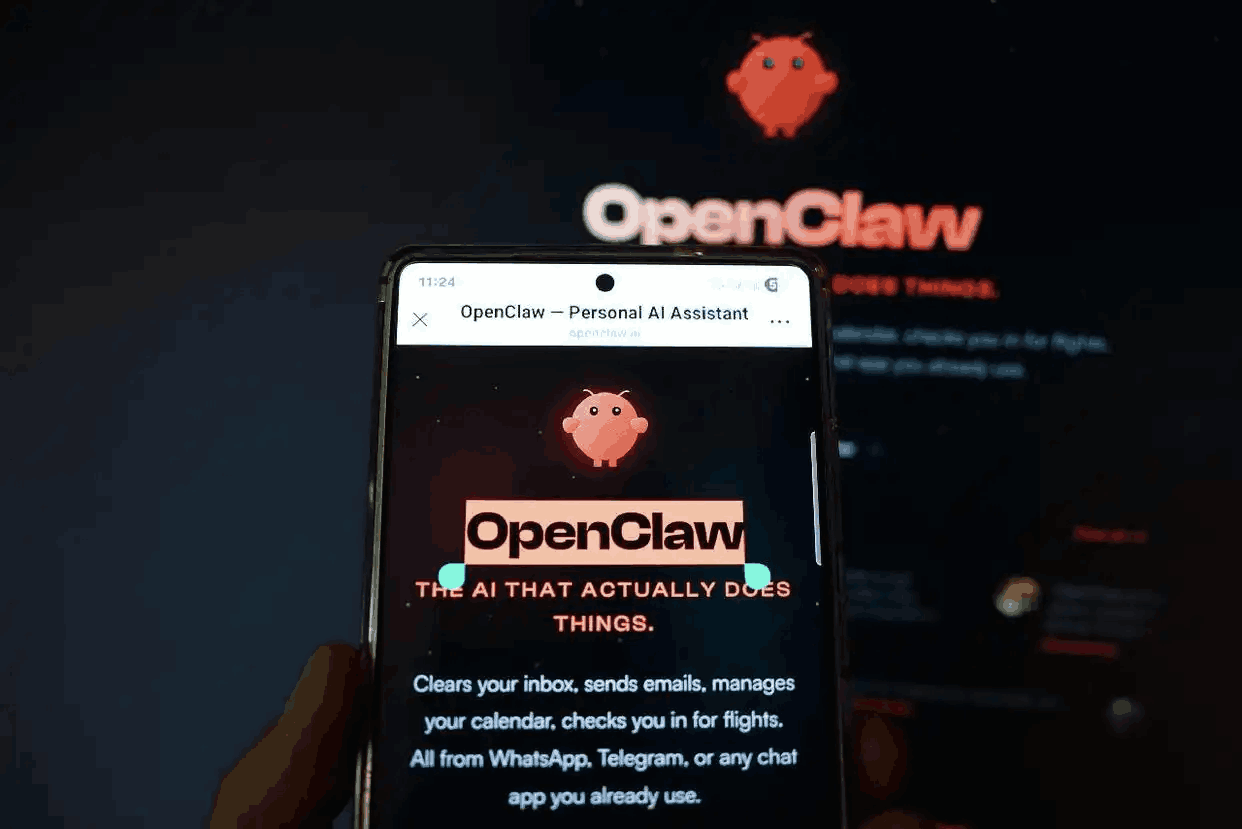

在人工智能技术飞速发展的今天,如何高效配置和部署强大的AI模型成为开发者与企业的关注焦点。OpenClaw作为一个开源项目,与清华大学的ChatGLM大型语言模型结合,为构建本地化、可定制的智能对话系统提供了有力工具。本文将深入探讨OpenClaw与ChatGLM的配置流程与关键要点,助您快速搭建专属AI应用。

OpenClaw通常指一系列围绕ChatGLM模型开发的工具、接口或优化方案,旨在降低模型部署与集成的技术门槛。ChatGLM作为基于通用语言模型架构的双语对话模型,具备出色的上下文理解和生成能力。成功配置两者的首要步骤是准备基础环境,这包括确保计算机拥有足够的GPU显存(建议8GB以上),并正确安装CUDA、PyTorch等深度学习框架与依赖库。一个稳定且版本匹配的环境是后续所有工作的基石。

接下来是获取模型权重的关键环节。用户需从官方认可的渠道下载ChatGLM的模型文件,这可能涉及申请或使用开源发布的版本。将下载的模型文件放置在OpenClaw项目指定的目录下,并根据项目文档修改配置文件中的模型路径参数。这一步骤直接关系到系统能否正确加载预训练好的AI能力核心。

配置过程中的核心是对OpenClaw项目设置文件的调整。用户需要仔细查阅项目文档,关注如模型精度、推理后端、服务端口等关键配置项。例如,选择使用FP16精度可以在保持较高模型性能的同时显著降低显存占用。此外,网络服务配置决定了AI模型将以何种接口(如REST API或WebSocket)对外提供服务,这需要根据实际应用场景进行设定。

完成基本配置后,启动服务并进行测试验证是不可或缺的一环。运行启动脚本后,通过发送测试查询来验证对话接口是否正常响应。初次运行时,模型可能需要加载与编译,耐心等待直至服务就绪。成功的配置应能返回流畅、相关的对话回复。在此阶段,开发者还可以进一步调整生成参数,如响应温度、最大生成长度等,以优化对话质量与风格。

为了获得更佳的性能与体验,高级配置与优化值得考虑。这包括探索模型量化技术以在资源受限环境中运行,或者集成检索增强生成模块以扩展模型知识边界。同时,部署反向代理、设置身份验证机制等,能增强生产环境中的安全性与可靠性。持续关注OpenClaw与ChatGLM社区的更新,也能及时获取性能提升和漏洞修复。

总而言之,配置OpenClaw与ChatGLM是一个系统性的工程,涉及环境准备、模型部署、参数调优等多个环节。通过遵循清晰的步骤并深入理解关键配置项,即使是初学者也能逐步建立起功能强大的本地AI对话系统。随着技术的不断迭代,这一组合将为更多创新应用提供坚实而灵活的基础支撑。